Réglage des hyperparamètres pour les modèles de notation des leads

Ajustez les taux d'apprentissage, la profondeur de l'arborescence et la régularisation pour améliorer la notation des leads ; utilisez Grid, Random, Bayesian ou Successive Halving et optimisez ROC AUC.

Le réglage des hyperparamètres peut faire ou défaire votre modèle de notation des prospects. Il ne s’agit pas seulement de l’algorithme que vous choisissez : il s’agit également d’affiner les paramètres qui guident la manière dont votre modèle apprend. Voici pourquoi c'est important :

- Améliorez les performances : même une amélioration de 1 % de la précision peut entraîner des gains financiers significatifs. Par exemple, un modèle LightGBM optimisé a augmenté le bénéfice projeté de 88 830 $ à 89 925 $.

- Éviter les pièges : un réglage approprié permet d'éviter le surapprentissage (trop spécifique aux données d'entraînement) ou le sous-apprentissage (modèles clés manquants), garantissant ainsi des prédictions fiables.

- Paramètres clés : concentrez-vous sur les paramètres importants tels que les taux d'apprentissage, la profondeur de l'arbre et la force de régularisation. Pour la régression logistique, le réglage de

Cet du type de pénalité est essentiel. Pour les modèles arborescents, des paramètres tels quemax_depthetn_estimatorsfont une grande différence.

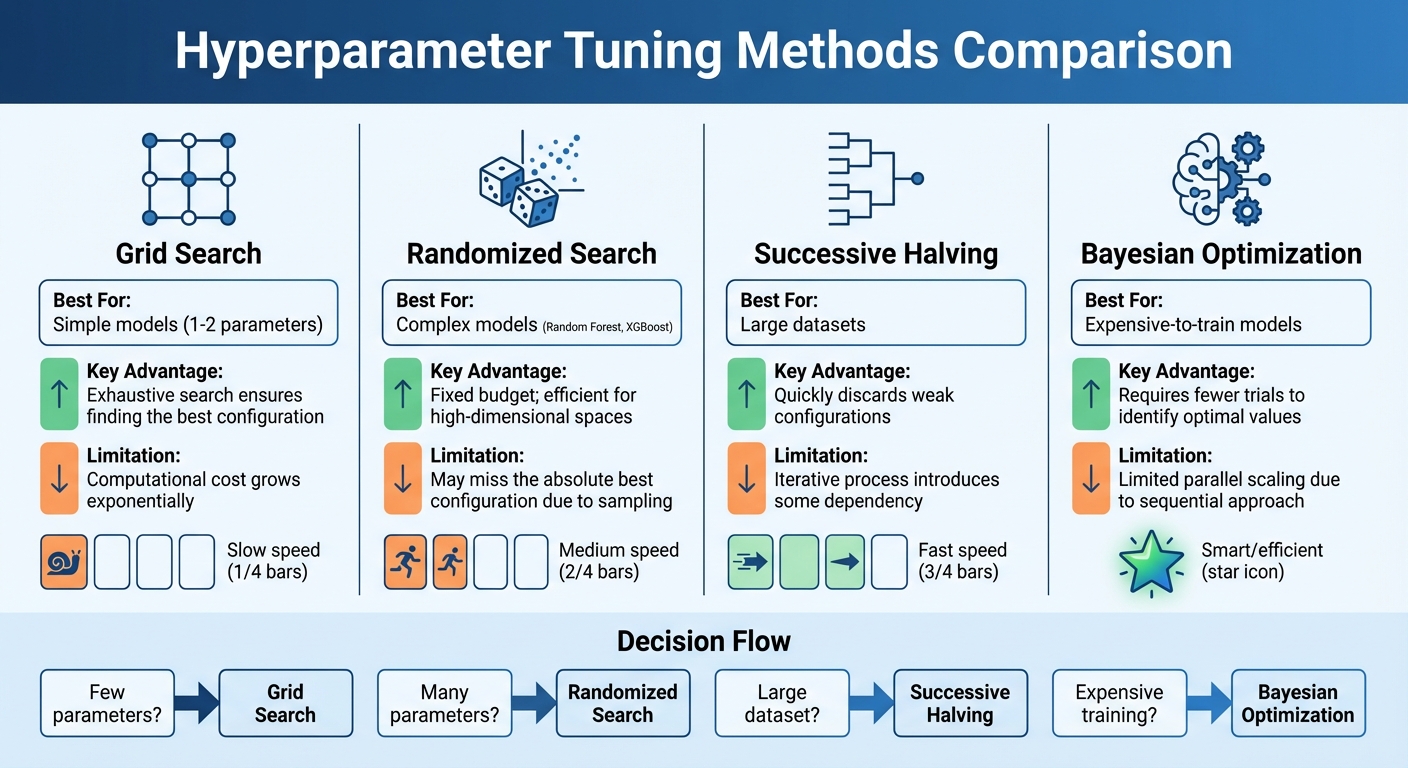

Méthodes de réglage :

- Grid Search : teste toutes les combinaisons de paramètres, mais nécessite beaucoup de ressources.

- Recherche aléatoire : exemples de combinaisons de paramètres, gain de temps.

- Optimisation bayésienne : utilise les résultats antérieurs pour prédire les meilleurs paramètres, idéal pour les modèles complexes.

- Réduction de moitié successive : élimine rapidement les mauvaises configurations en testant par étapes.

Bonnes pratiques :

- Concentrez-vous d'abord sur les paramètres ayant un impact.

- Utilisez des métriques telles que ROC AUC, la précision et le rappel au lieu de simplement la précision.

- Appliquez vos connaissances du domaine pour définir des plages réalistes et éviter le surajustement.

Le réglage des hyperparamètres transforme la notation des leads en un processus précis et basé sur les données qui aide les équipes commerciales à prioriser efficacement les leads à forte valeur ajoutée.

Réglage des hyperparamètres pour l'apprentissage automatique : guide du débutant

Hyperparamètres clés dans les algorithmes de notation des leads

Le réglage des hyperparamètres est crucial pour optimiser les modèles d'apprentissage automatique utilisés dans la notation des prospects. Chaque algorithme est livré avec son propre ensemble de paramètres qui peuvent avoir un impact significatif sur les performances. Examinons les hyperparamètres clés de trois algorithmes couramment utilisés dans la notation des leads.

Régression logistique

Le paramètre le plus important ici est C (Inverse Regularization Strength). Cela contrôle le compromis entre l'ajustement des données de formation et le maintien de la simplicité pour une meilleure généralisation. Des valeurs plus petites de C imposent une régularisation plus forte, réduisant le surapprentissage mais manquant éventuellement de modèles subtils. Des valeurs plus élevées permettent une plus grande complexité mais peuvent entraîner un surajustement des données [7]. Par exemple, il a été démontré que l'utilisation de GridSearchCV pour affiner ce paramètre améliore considérablement la précision de la régression logistique [7].

Le type de pénalité joue également un rôle majeur. La pénalité L1 (Lasso) peut réduire certains coefficients à zéro, supprimant ainsi les caractéristiques non pertinentes, tandis que la pénalité L2 (Ridge) réduit les coefficients.sans les éliminer complètement [7]. De plus, le paramètre solver détermine l'efficacité avec laquelle le modèle converge. Pour les grands ensembles de données, saga ou sag sont préférés pour un traitement plus rapide, tandis que liblinear fonctionne mieux pour les petits ensembles de données [7].

Si le modèle a du mal à converger (ce qui est courant dans scikit-learn), augmenter max_iter à 1 000 ou plus peut résoudre les avertissements [7]. Explorons ensuite les hyperparamètres pour les méthodes arborescentes, qui nécessitent une approche différente.

Arbres de décision et forêts aléatoires

Pour les arbres de décision, max_degree est un paramètre critique. Il limite la profondeur de l'arbre, équilibrant la capacité à capturer le comportement des leads sans surajustement. En règle générale, une profondeur optimale se situe entre 4 et 10 [10]. Min_samples_split définit le nombre minimum d'échantillons requis pour diviser un nœud, garantissant que le modèle ne crée pas de règles basées sur trop peu de leads, ce qui améliore sa capacité à généraliser [8].

Un autre paramètre clé, min_samples_leaf, garantit que chaque nœud terminal contient un nombre minimum d'échantillons, réduisant ainsi le risque de priorisation excessive des valeurs aberrantes [8]. Dans Random Forests, n_estimators détermine le nombre d'arbres à construire. Bien que l'augmentation de cette valeur améliore généralement la précision et la stabilité, elle augmente également les coûts de calcul [9][5]. Parallèlement, max_features introduit le caractère aléatoire en limitant le nombre de fonctionnalités prises en compte à chaque division, ce qui permet au modèle de rester robuste même avec des données principales bruyantes ou incomplètes. [8][9].

"Les performances des arbres de décision dépendent fortement des hyperparamètres, la sélection de l'hyperparamètre optimal peut avoir un impact significatif sur la précision, la capacité de généralisation et la robustesse du modèle." - GeeksforGeeks [8]

Le déséquilibre des classes est un problème courant dans les ensembles de données de notation des leads, où les non-convertisseurs sont de loin plus nombreux que les convertis. Des paramètres tels que min_weight_fraction_leaf et scale_pos_weight permettent de garantir que le modèle ne penche pas en faveur de la classe majoritaire [8][11]. Pour les grands ensembles de données, des outils tels que RandomizedSearchCV ou HalvingRandomSearchCV peuvent accélérer la recherche d'hyperparamètres optimaux [8][5].

Modèles d'amélioration des dégradés

Les modèles d'amplification de dégradé nécessitent des réglages minutieux pour équilibrer complexité et performances. Le taux d'apprentissage (eta) fonctionne en tandem avec les n_estimators. Un taux d'apprentissage plus faible améliore la généralisation mais nécessite davantage de cycles de boosting, ce qui augmente le temps de formation [14][15]. Au lieu de sélectionner manuellement le nombre d'estimateurs, il est souvent préférable de définir n_estimators élevé et de s'appuyer sur un arrêt précoce pour éviter le surajustement lorsque les performances de validation plafonnent. [12][14].

Max_degree contrôle la complexité des arbres et détermine le niveau d'interaction entre les entités principales. Bien que les arbres plus profonds puissent mieux s'adapter aux données d'entraînement, ils risquent également un surajustement. Une profondeur optimale est généralement comprise entre 4 et 10 [12][10]. Des paramètres tels que subsample et colsample_bytree introduisent le caractère aléatoire en utilisant uniquement un sous-ensemble de données ou de fonctionnalités pour chaque arbre, ce qui permet d'éviter une dépendance excessive à l'égard d'échantillons spécifiques. [11][13].

Pour les ensembles de données déséquilibrés, scale_pos_weight est particulièrement utile. Il ajuste le poids des leads positifs, améliorant ainsi la capacité du modèle à détecter les leads de grande valeur dans des ensembles de données asymétriques [11][13]. LightGBM, un framework d'amélioration de gradient populaire, utilise la croissance des arbres par feuilles pour une convergence plus rapide. Cependant, cela nécessite de régler des paramètres tels que num_leaves et min_data_in_leaf pour éviter le surajustement. Pour les ensembles de données volumineux, définir min_data_in_leaf sur des valeurs plus élevées (centaines ou milliers) garantit que le modèle ne crée pas de règles trop spécifiques qui ne se généralisent pas bien [14].

| Hyperparamètre | Rôle principal | Impact sur la notation des leads |

|---|---|---|

| taux_d'apprentissage | Rétrécissement de la taille du pas | Des valeurs plus petites améliorent la précision mais nécessitent plus d'arbres |

| n_estimateurs | Nombre de tours de boost | Des valeurs plus élevées capturent plus de modèles mais risquent un surajustement |

| profondeur_maximale | Complexité de l'arborescence | Contrôle le niveau d'interaction entre les fonctionnalités principales |

| sous-échantillon | Randomisation | Empêche une dépendance excessive à l'égard d'échantillons d'entraînement spécifiques |

| scale_pos_weight | Équilibrage des classes | Ajuste les pondérations des pistes positives dans les ensembles de données déséquilibrés |

Chaque algorithme possède son propre ensemble d'hyperparamètres qui peuvent améliorer ou défaire ses performances. En ajustant ces paramètres, vous garantissez que votre modèle de notation des prospects est à la fois précis et fiable, quels que soient les défis de l'ensemble de données.

Techniques de réglage des hyperparamètres

Lead Scoring Models" style="max-width:100%; margin:1em auto; display:block;">

Lead Scoring Models" style="max-width:100%; margin:1em auto; display:block;">

Réglage des hyperparamètresComparaison des méthodes pour les modèles de notation des leads

Une fois que vous avez identifié les hyperparamètres clés de votre modèle de notation des prospects, l'étape suivante consiste à sélectionner une méthode de réglage capable d'améliorer efficacement ses performances. Vous trouverez ci-dessous quelques techniques courantes, chacune adaptée à différents scénarios.

Recherche par grille

La recherche par grille est une approche méthodique qui teste toutes les combinaisons possibles de valeurs d'hyperparamètres prédéfinis [5]. Par exemple, si vous réglez un modèle de régression logistique avec trois valeurs possibles pour le paramètre de régularisation C (0,1, 1,0, 10,0) et deux types de pénalité (L1, L2), Grid Search évaluera les six combinaisons. Cette approche approfondie fonctionne bien pour les modèles comportant seulement quelques hyperparamètres, mais devient coûteuse en termes de calcul à mesure que le nombre de paramètres augmente. [5].

Recherche aléatoire

Contrairement à la recherche par grille, la recherche aléatoire n'évalue pas toutes les combinaisons. Au lieu de cela, il échantillonne de manière aléatoire un nombre défini de configurations à partir de distributions prédéfinies [16]. Vous contrôlez le processus en définissant un nombre fixe d'itérations (n_iter), permettant une exploration efficace de l'espace des hyperparamètres [5]. Cette méthode est particulièrement utile pour les modèles comportant de nombreux paramètres, comme les forêts aléatoires, car elle évite le coût exponentiel en temps des recherches exhaustives. Il est particulièrement efficace pour les paramètres continus, tels que les taux d'apprentissage, où des distributions telles que loguniform peuvent aider à explorer une large plage de valeurs.

Méthodes avancées : recherche bayésienne et grille de réduction de moitié

Pour les scénarios dans lesquels les ressources informatiques sont limitées ou la formation est coûteuse, les méthodes avancées offrent des alternatives plus efficaces.

- Réduction de moitié successive : Cette technique fonctionne comme un tournoi. Toutes les configurations d'hyperparamètres sont initialement testées avec un minimum de ressources, comme un petit sous-ensemble de données d'entraînement. Seuls les plus performants passent au tour suivant, où ils reçoivent plus de ressources. Cette approche élimine rapidement les options les plus faibles, ce qui la rend idéale pour les grands ensembles de données. Par exemple, si votre modèle de notation des leads traite des millions d'enregistrements, des outils tels que HalvingRandomSearchCV peuvent identifier efficacement les combinaisons d'hyperparamètres prometteuses [5].

- Optimisation bayésienne : cette méthode traite le réglage des hyperparamètres comme un problème de régression, en utilisant les résultats antérieurs pour prédire les configurations les plus prometteuses [4]. Il établit un équilibre intelligent entre l’exploration de nouvelles possibilités et le raffinement des bonnes options connues. L'optimisation bayésienne est particulièrement efficace pour les problèmes comportant moins de 20 dimensions [17], ce qui en fait un excellent choix lorsque la précision est essentielle et que la formation nécessite beaucoup de ressources. Cependant, son caractère séquentiel peut limiter le traitement parallèle [3].

| Technique | Idéal pour | Avantage clé | Limitation |

|---|---|---|---|

| Recherche par grille | Modèles simples (1 à 2 paramètres) | La recherche exhaustive garantit la recherche de la meilleure configuration | Le coût de calcul augmente de façon exponentielle |

| Recherche aléatoire | Modèles complexes (Random Forest, XGBoost) | Budget fixe ; efficace pour les espaces de grande dimension | Peut manquer la meilleure configuration absolue en raison de l'échantillonnage |

| Réduction de moitié successive | Grands ensembles de données | Élimine rapidement les configurations faibles | Le processus itératif introduit une certaine dépendance |

| Optimisation bayésienne | Modèles coûteux à former | Nécessite moins d'essais pour identifier les valeurs optimales | Mise à l'échelle parallèle limitée en raison de l'approche séquentielle |

Nous aborderons ensuite les bonnes pratiques pour affiner les hyperparamètres dans les modèles de notation des prospects.

sbb-itb-817c6a5

Bonnes pratiques pour le réglage des hyperparamètres dans la notation des leads

En s'appuyant sur les techniques de réglage évoquées précédemment, ces bonnes pratiques peuvent vous aider à affiner votre modèle pour de meilleures performances.

Commencez par les paramètres les plus impactants

Une fois que vous avez identifié les hyperparamètres clés, concentrez-vous sur ceux qui ont la plus grande influence sur les performances de votre modèle. Souvent, seul un petit nombre de paramètres ont un impact significatif sur les résultats, tandis que d'autres peuvent conserver leurs paramètres par défaut [5][3]. Considérez les hyperparamètres comme les cadrans critiques de votre modèle : de petits ajustements peuvent entraîner de grands changements.

Pour la Régression logistique, donnez la priorité au réglage de C (force de régularisation) et au type de pénalité (L1 ou L2). Ceux-ci contrôlent le surajustement et permettent la sélection automatique des fonctionnalités, en particulier lorsque vous travaillez avec des données client de grande dimension. Pour les modèles arborescents comme Random Forest ou Gradient Boosting, concentrez-vous sur des paramètres tels que n_estimators, max_depth et min_samples_leaf pour trouver un équilibre entre la complexité et la précision du modèle. Avec le Gradient Boosting, le learning_rate est particulièrement important, car il influence le comportement d'autres paramètres. [5][1][[HTML_ 474]][2][18].

Le Google Deep Learning Tuning Playbook suggère de classer les paramètres en deux groupes : "scientifiques" (ceux qui mesurent des effets spécifiques, comme la profondeur du modèle) et "nuisants" (ceux qui garantissent des comparaisons équitables, comme le taux d'apprentissage). [18]. Start simple, et augmente progressivement la complexité :

"Le moyen le plus efficace d'optimiser les performances est de commencer par une configuration simple, puis d'ajouter progressivement des fonctionnalités et d'apporter des améliorations tout en obtenant une meilleure compréhension du problème." [18]

Lorsque vous explorez des plages de paramètres tels que les taux d'apprentissage ou les forces de régularisation, utilisez une échelle logarithmique plutôt qu'une échelle linéaire [3]. Par exemple, testez les taux d'apprentissage à 0,001, 0,01, 0,1 et 1,0 au lieu d'utiliser des étapes linéaires comme 0,1, 0,2, 0,3 et 0,4. Cette approche capture plus efficacement les différences significatives.

Utilisez les bonnes mesures d'évaluation

La précision seule peut être trompeuse dans la notation des leads. Par exemple, si 95 % de vos prospects ne se convertissent pas, un modèle qui prédit "aucune conversion" pour chaque prospect atteindrait quand même une précision de 95 %, mais il n'apporterait aucune valeur à votre entreprise. [5][21]. C'est pourquoi des statistiques plus nuancées sont essentielles.

LaROC AUC (Zone sous la courbe des caractéristiques opérationnelles du récepteur) est un choix populaire pour la notation des leads. Il mesure dans quelle mesure votre modèle distingue les prospects convertis et non convertis sur tous les seuils de probabilité, ce qui le rend idéal pour classer les prospects en fonction de leur probabilité de conversion [21].

Autres statistiques à prendre en compte :

- Précision : cela vous indique combien de prospects votre modèle identifie comme étant de grande valeur sont réellement convertis. C'est particulièrement important lorsque les ressources commerciales sont limitées.

- Rappel : cela mesure le pourcentage de convertisseurs réels que votre modèle identifie correctement. C'est essentiel lorsque manquer ne serait-ce qu'un seul prospect potentiel pourrait nuire aux revenus.

- F1-Score : cette mesure équilibre précision et rappel, ce qui la rend utile pour les ensembles de données dans lesquels les non-conversions dépassent largement les conversions [21].

Vous pouvez également créer des statistiques commerciales personnalisées adaptées à vos objectifs. Par exemple, une étude de cas optimisée pour le profit en prenant en compte 120 $ de revenus par conversion contre un coût de 15 $ pour la sensibilisation. Cette approche a conduit à une augmentation de 1,2 % du bénéfice total. [2] :

"Les métriques d'évaluation du machine learning que vous choisissez doivent refléter les métriques commerciales que vous souhaitez optimiser avec la solution de machine learning" [20]

| Métrique | Alignement commercial | Quand établir des priorités |

|---|---|---|

| ROC AUC | Hiérarchisation des leads | Classement des prospects par probabilité de conversion |

| Précision | Efficacité commerciale | Lorsque les ressources commerciales sont limitées |

| Rappel | Maximisation des revenus | Lorsque manquer des prospects prêts à être convertis coûte cher |

| Score F1 | Performances équilibrées | Éviter les préjugés en faveur de la précision ou du rappel |

Les bonnes mesures, combinées à la connaissance du domaine, peuvent rendre votre processus de réglage plus efficace.

Appliquer les connaissances du domaine

L'expertise commerciale joue un rôle crucial dans la définition de plages d'hyperparamètres réalistes, ce qui peut permettre de gagner du temps de calcul et d'améliorer la généralisation de votre modèle [3]. Par exemple, comprendre le comportement des clients peut vous aider à évaluer les coûts d’une mauvaise classification. Si les ressources commerciales sont limitées, privilégiez la précision. En revanche, si manquer ne serait-ce qu'un seul prospect qualifié peut entraîner une perte importante, concentrez-vous sur le rappel [2][19].

Des outils tels que SHAP valeurs peuvent vous aider à garantir que vos choix d'hyperparamètres n'introduisent pas involontairement de fuite de données ou ne mettent pas trop l'accent sur des modèles non pertinents. [2]. Par exemple, si les données historiques montrent que les prospects qui passent plus de 20 minutes sur votre site Web ont un taux de conversion de 90 %, ces informations peuvent guider les décisions concernant la profondeur de l'arborescence ou les interactions avec les fonctionnalités.

Dans un ensemble de données de plus de 9 000 entrées, l'application des connaissances du domaine pour éliminer les indicateurs économiques hautement corrélés à l'aide du facteur d'inflation de variance (VIF) a amélioré l'interprétabilité du modèle sans sacrifier les performances [21]. Cela montre comment la combinaison de l'expertise commerciale avec des techniques statistiques peut conduire à des modèles non seulement précis, mais également exploitables pour votre équipe.

Mise en œuvre du réglage des hyperparamètres avec scikit-learn

Scikit-learn simplifie le réglage des hyperparamètres grâce à ses outils intégrés. Pour éviter les erreurs causées par des fautes de frappe ou des noms de paramètres incorrects, utilisez estimator.get_params() pour vérifier les paramètres disponibles. Lorsque vous travaillez sur la notation des prospects, il est préférable d'optimiser les probabilités (par exemple, scoring="roc_auc" ou scoring="average_precision") plutôt que les prédictions binaires, en particulier lorsqu'il s'agit d'ensembles de données déséquilibrés.

Pour un réglage plus rapide, définissez n_jobs=-1 pour utiliser tous les cœurs de processeur disponibles et utilisez error_score=0 pour gérer les combinaisons de paramètres problématiques sans interrompre le processus. Divisez toujours votre ensemble de données en un ensemble de développement pour le réglage et un ensemble d'évaluation distinct pour tester les performances sur des données invisibles. Par défaut, scikit-learn recycle le meilleur modèle sur l'ensemble de données lorsque refit=True est activé.

Exemple de recherche de grille pour la régression logistique

Lors du réglage de la régression logistique pour la notation des leads, concentrez-vous sur l'ajustement de la force de régularisation (C) et du type de pénalité (l1 ou l2). Voici un exemple de mise en œuvre de la recherche par grille à cet effet :

from sklearn.model_selection import GridSearchCV

from sklearn.linear_model import LogisticRegression

from sklearn.model_selection import RepeatedStratifiedKFold

# Define the parameter grid

param_grid = {

'C': [0.001, 0.01, 0.1, 1.0, 10.0, 100.0],

'penalty': ['l1', 'l2'],

'solver': ['liblinear'] # Required for l1 penalty

}

# Set up the model

model = LogisticRegression(max_iter=1000, random_state=42)

# Configure cross-validation

cv = RepeatedStratifiedKFold(n_splits=5, n_repeats=3, random_state=42)

# Create the grid search

grid_search = GridSearchCV(

estimator=model,

param_grid=param_grid,

scoring='roc_auc',

cv=cv,

n_jobs=-1,

error_score=0

)

# Fit on your lead data

grid_search.fit(X_train, y_train)

# Access the best parameters and score

print(f"Best parameters: {grid_search.best_params_}")

print(f"Best ROC AUC: {grid_search.best_score_:.4f}")

Le paramètre C est test calculé sur une échelle logarithmique pour identifier les différences significatives sur une large plage de valeurs. Pour un réglage plus rapide, envisagez d'utiliser LogisticRegressionCV, qui est optimisé pour calculer le chemin de régularisation.

Exemple de recherche aléatoire pour les arbres de décision

Lorsque l'espace des paramètres est grand, RandomizedSearchCV est une option plus efficace par rapport à la recherche exhaustive sur grille. Il teste un nombre fixe de combinaisons de paramètres, ce qui le rend idéal pour les modèles tels que les arbres de décision. Voici un exemple :

from sklearn.model_selection import RandomizedSearchCV

from sklearn.tree import DecisionTreeClassifier

from scipy.stats import randint

# Define parameter distributions

param_distributions = {

'max_depth': randint(3, 20),

'min_samples_split': randint(2, 50),

'min_samples_leaf': randint(1, 30),

'class_weight': ['balanced', None]

}

# Set up the model

model = DecisionTreeClassifier(random_state=42)

# Create the randomized search

random_search = RandomizedSearchCV(

estimator=model,

param_distributions=param_distributions,

n_iter=100, # Number of parameter combinations to try

scoring='roc_auc',

cv=5,

n_jobs=-1,

random_state=42,

error_score=0

)

# Fit on your lead data

random_search.fit(X_train, y_train)

# Get results

print(f"Best parameters: {random_search.best_params_}")

print(f"Best ROC AUC: {random_search.best_score_:.4f}")

Le paramètre n_iter contrôle le nombre de combinaisons testées, vous permettant ainsi d'équilibrer la rigueur et les contraintes de temps. Pour un réglage encore plus rapide sur de grands ensembles de données, essayez HalvingRandomSearchCV, qui élimine les mauvaises combinaisons de paramètres au début du processus.

Dans une étude scikit-learn, les chercheurs ont utilisé GridSearchCV avec RepeatedStratifiedKFold (10 fois, 10 répétitions) pour comparer les noyaux SVC. Ils ont observé que le noyau « rbf » atteignait une AUC moyenne de 0,9400, tandis que le noyau « linéaire » obtenait un score de 0,9300 [22]. Cela montre à quel point un réglage systématique peut révéler des différences significatives dans les performances du modèle.

Une fois que vous avez affiné votre modèle avec la recherche aléatoire, vous pouvez l'intégrer dans votre flux de travail de notation des prospects pour de meilleurs résultats.

Utilisation de SalesMind AI pour la notation avancée des leads

Après avoir peaufiné votre modèle, intégrez-le à votre processus de vente pour une meilleure priorisation des leads. SalesMind AI peut intégrer de manière transparente votre modèle optimisé, en l'exploitant pour classer les prospects en fonction de leur probabilité de conversion. Grâce à des fonctionnalités telles qu'une boîte de réception unifiée alimentée par AI et des suivis automatisés, SalesMind AI garantit que les prospects hautement prioritaires reçoivent une attention immédiate, tandis que d'autres sont guidés à travers des séquences de développement. Cette combinaison de réglages précis et d'automatisation avancée peut augmenter considérablement l'efficacité de votre sensibilisation.

Conclusion

Principaux points à retenir

Le réglage des hyperparamètres fait passer la notation des leads d'un simple jeu de devinettes à un processus basé sur les données. Avec les bonnes configurations, votre modèle peut identifier plus précisément les prospects à forte valeur ajoutée, ce qui entraîne une meilleure efficacité commerciale et une augmentation des revenus. Commencez par des configurations simples et donnez la priorité aux paramètres les plus importants, comme la force de régularisation pour la régression logistique ou la profondeur de l'arbre pour les modèles d'ensemble. Les mesures telles que ROC AUC ou la précision moyenne fonctionnent mieux, en particulier lorsque votre ensemble de données est déséquilibré et que la plupart des prospects ne sont pas convertis.

Pour les petits espaces de paramètres, la recherche par grille est un choix fiable. La recherche aléatoire, en revanche, fournit des résultats comparables tout en nécessitant moins de ressources informatiques. Si vous êtes prêt à utiliser des techniques plus avancées, l'optimisation bayésienne offre un moyen intelligent d'explorer les paramètres en tirant les leçons des essais antérieurs. L'utilisation de politiques d'arrêt précoce conservatrices, telles que l'arrêt médian, peut réduire les coûts de calcul de 25 à 35 % sans compromettre la qualité du modèle [6]. Il est important de noter que l’alignement de votre stratégie de réglage sur les objectifs commerciaux – comme l’optimisation d’une mesure de profit personnalisée plutôt que d’une AUC standard – peut faire une différence tangible. Par exemple, un cas study a affiché des bénéfices passant de 88 830 $ à 89 925 $ en adoptant cette approche [2].

Ces stratégies fournissent une voie claire pour mettre en œuvre le réglage des hyperparamètres.

Étapes suivantes

Avec ces points à retenir, il est temps d'affiner et de mettre en œuvre votre modèle de notation des prospects. Commencez par auditer votre configuration actuelle pour identifier les hyperparamètres qui ont le plus d'influence sur votre ensemble de données. À partir de là, établissez un processus de réglage systématique à l'aide d'outils tels que scikit-learn. Gardez un œil sur les courbes d'entraînement et de validation pour détecter rapidement le surajustement et validez toujours votre modèle final sur un ensemble d'évaluation distinct pour garantir qu'il fonctionne correctement avec les nouveaux prospects.

Pour tirer le meilleur parti de votre modèle optimisé, SalesMind AI propose des outils pour rationaliser le processus. Il priorise automatiquement les prospects en fonction de leur probabilité de conversion, lance des séquences de sensibilisation personnalisées et achemine instantanément les prospects les mieux notés vers votre équipe commerciale. Cette combinaison d'une modélisation affinée et d'une automatisation intelligente garantit que vos principaux prospects reçoivent une attention immédiate, tandis que votre équipe peut se concentrer sur la conclusion de transactions au lieu de trier les prospects non qualifiés.

FAQ

Comment le réglage des hyperparamètres améliore-t-il la précision des modèles de notation des prospects ?

Le réglage des hyperparamètres est une étape clé dans l'amélioration de la précision des modèles de notation des leads. L'ajustement de paramètres tels que le taux d'apprentissage, la force de régularisation ou la profondeur de l'arbre aide le modèle à identifier plus efficacement les modèles dans les données, ce qui donne lieu à des prédictions beaucoup plus fiables.

Lorsqu'un modèle de notation des prospects est correctement affiné, il attribue des scores qui correspondent étroitement aux véritables chances de conversion d'un prospect. Cela permet aux entreprises de se concentrer sur les prospects à fort potentiel, ce qui permet de rationaliser les efforts de vente et d'améliorer les résultats.

Quelle est la différence entre la recherche par grille et l'optimisation bayésienne pour le réglage des hyperparamètres ?

Grid Search fonctionne en testant systématiquement toutes les combinaisons possibles d'hyperparamètres spécifiés dans une plage donnée. Cette méthode garantit que la meilleure configuration au sein du réseau sera trouvée. Cependant, cela peut devenir très gourmand en ressources, en particulier lorsque vous travaillez avec un grand nombre de paramètres ou des ensembles de données étendus.

En revanche, l'optimisation bayésienne adopte une approche plus intelligente. Il utilise un modèle probabiliste pour prédire les performances de différentes combinaisons d'hyperparamètres. En se concentrant sur les domaines les plus prometteurs, il peut identifier plus efficacement les configurations optimales. Cela en fait un excellent choix pour les scénarios impliquant des données de grande dimension ou des ressources informatiques limitées. Cela dit, cela entraîne une surcharge de calcul supplémentaire pour maintenir le modèle et peut être sensible à la stratégie d'optimisation choisie.

Pour faire simple, la Grid Search est une option simple pour les petits problèmes, tandis que l'L'optimisation bayésienne brille dans la résolution de problèmes de réglage plus complexes ou à grande échelle où l'efficacité compte.

Pourquoi l'AUC ROC est-elle une meilleure mesure que la précision pour évaluer les modèles de notation des prospects ?

Lorsqu'il s'agit d'évaluer les modèles de notation des prospects, ROC AUC surpasse souvent la précision, notamment parce que les ensembles de données de notation des leads ont tendance à être déséquilibrés. Dans ces scénarios, la précision peut sembler impressionnante à première vue, mais elle peut être trompeuse - ne reflétant pas la capacité du modèle à identifier des pistes précieuses.

Ce qui distingue ROC AUC, c'est sa capacité à évaluer dans quelle mesure le modèle différencie les pistes positives et négatives pour chaque seuil de décision possible. Cela en fait une mesure beaucoup plus fiable pour comprendre l'efficacité avec laquelle le modèle classe et priorise les prospects de haute qualité.