Ajuste de hiperparámetros para modelos de puntuación de clientes potenciales

Ajuste las tasas de aprendizaje, la profundidad del árbol y la regularización para aumentar la puntuación de clientes potenciales; utilice Grid, Random, Bayesian o Successive Halving y optimice ROC AUC.

El ajuste de hiperparámetros puede mejorar o deshacer su modelo de puntuación de clientes potenciales. No se trata sólo del algoritmo que elijas, sino de ajustar la configuración que guía cómo aprende tu modelo. He aquí por qué esto es importante:

- Aumente el rendimiento: Incluso una mejora del 1% en la precisión puede generar ganancias financieras significativas. Por ejemplo, un modelo LightGBM optimizado aumentó la ganancia proyectada de $88,830 a $89,925.

- Evita errores: el ajuste adecuado ayuda a evitar el sobreajuste (demasiado específico para los datos de entrenamiento) o el desajuste (faltan patrones clave), lo que garantiza predicciones confiables.

- Parámetros clave: céntrese en configuraciones impactantes como tasas de aprendizaje, profundidad de árbol y fuerza de regularización. Para la regresión logística, ajustar

Cy el tipo de penalización es fundamental. Para los modelos basados en árboles, parámetros comomax_depthyn_estimatorsmarcan una gran diferencia.

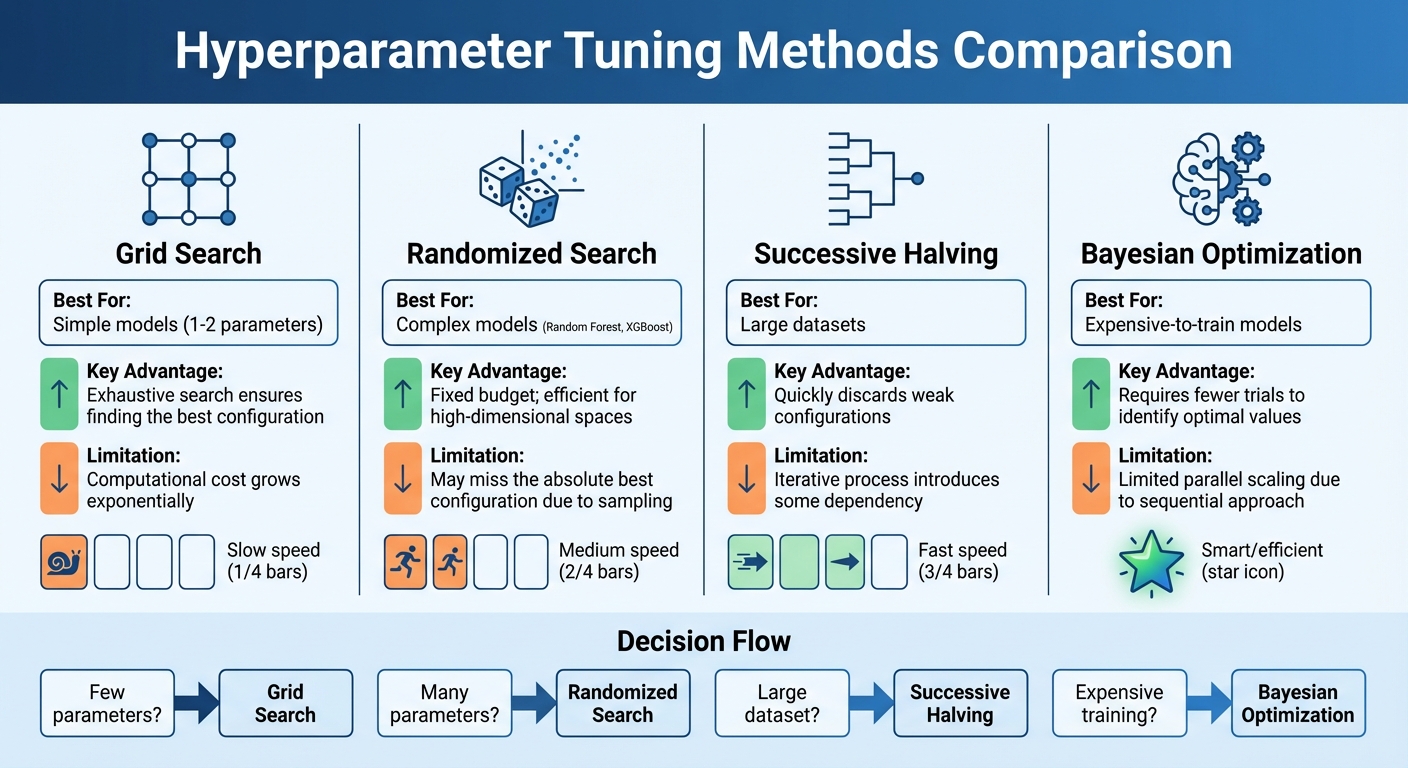

Métodos de ajuste:

- Búsqueda de cuadrícula: prueba todas las combinaciones de parámetros pero consume muchos recursos.

- Búsqueda aleatoria: Combinaciones de parámetros de muestra, ahorrando tiempo.

- Optimización bayesiana: utiliza resultados anteriores para predecir la mejor configuración, ideal para modelos complejos.

- Reducción a la mitad sucesiva: Elimina rápidamente configuraciones deficientes probando por etapas.

Prácticas recomendadas:

- Céntrate primero en los parámetros impactantes.

- Utiliza métricas como ROC AUC, precisión y recuperación en lugar de solo precisión.

- Aplica el conocimiento del dominio para establecer rangos realistas y evitar el sobreajuste.

El ajuste de hiperparámetros transforma la puntuación de clientes potenciales en un proceso preciso basado en datos que ayuda a los equipos de ventas a priorizar clientes potenciales de alto valor de manera efectiva.

Ajuste de hiperparámetros para el aprendizaje automático: una guía para principiantes

Hiperparámetros clave en algoritmos de puntuación de clientes potenciales

El ajuste de los hiperparámetros es crucial para optimizar los modelos de aprendizaje automático utilizados en la puntuación de clientes potenciales. Cada algoritmo viene con su propio conjunto de parámetros que pueden afectar significativamente el rendimiento. Profundicemos en los hiperparámetros clave de tres algoritmos comúnmente utilizados en la puntuación de clientes potenciales.

Regresión logística

El parámetro más importante aquí es C (Fuerza de regularización inversa). Esto controla el equilibrio entre ajustar los datos de entrenamiento y mantener la simplicidad para una mejor generalización. Los valores más pequeños de C imponen una regularización más fuerte, lo que reduce el sobreajuste pero posiblemente faltan patrones sutiles. Los valores más grandes permiten una mayor complejidad, pero pueden generar ruido de sobreajuste en los datos [7]. Por ejemplo, se ha demostrado que el uso de GridSearchCV para ajustar este parámetro mejora significativamente la precisión de la regresión logística [7].

El tipo de penalización también juega un papel importante. La penalización L1 (Lazo) puede reducir algunos coeficientes a cero, eliminando efectivamente características irrelevantes, mientras que la penalización L2 (Ridge) reduce los coeficientes.sin eliminarlos por completo [7]. Además, el parámetro solver determina la eficiencia con la que converge el modelo. Para conjuntos de datos grandes, se prefieren saga o sag para un procesamiento más rápido, mientras que liblinear funciona mejor para conjuntos de datos más pequeños [7].

Si el modelo tiene dificultades para converger (común en scikit-learn), aumentar max_iter a 1000 o más puede resolver las advertencias [7]. A continuación, exploremos los hiperparámetros para métodos basados en árboles, que requieren un enfoque diferente.

Árboles de decisión y bosques aleatorios

Para árboles de decisión, max_ Depth es un parámetro crítico. Limita la profundidad del árbol, equilibrando la capacidad de capturar el comportamiento de los clientes potenciales sin sobreajustarlo. Normalmente, una profundidad óptima se sitúa entre 4 y 10 [10]. Min_samples_split define el número mínimo de muestras necesarias para dividir un nodo, lo que garantiza que el modelo no cree reglas basadas en muy pocos clientes potenciales, lo que mejora su capacidad de generalizar [8].

Otro parámetro clave, min_samples_leaf, garantiza que cada nodo terminal contenga un número mínimo de muestras, lo que reduce el riesgo de priorizar excesivamente valores atípicos [8]. En Random Forests, n_estimators determina cuántos árboles se construyen. Si bien aumentar esto generalmente aumenta la precisión y la estabilidad, también aumenta los costos computacionales [9][5]. Mientras tanto, max_features introduce aleatoriedad al limitar el número de características consideradas en cada división, lo que ayuda a que el modelo se mantenga robusto incluso con datos de clientes potenciales ruidosos o incompletos. [8][9].

"El rendimiento de los árboles de decisión depende en gran medida de los hiperparámetros; seleccionar el hiperparámetro óptimo puede afectar significativamente la precisión, la capacidad de generalización y la solidez del modelo". - GeeksforGeeks [8]

El desequilibrio de clases es un desafío común en los conjuntos de datos de puntuación de clientes potenciales, donde los que no realizan conversiones superan con creces a los que realizan conversiones. Parámetros como min_weight_fraction_leaf y scale_pos_weight ayudan a garantizar que el modelo no se sesgue hacia la clase mayoritaria [8][11]. Para conjuntos de datos grandes, herramientas como RandomizedSearchCV o HalvingRandomSearchCV pueden acelerar la búsqueda de hiperparámetros óptimos. [8][5].

Modelos de impulso de gradiente

Los modelos de aumento de gradiente requieren un ajuste cuidadoso para equilibrar la complejidad y el rendimiento. La tasa de aprendizaje (eta) funciona en conjunto con los n_estimators. Una tasa de aprendizaje menor mejora la generalización, pero requiere más rondas de impulso, lo que aumenta el tiempo de entrenamiento [14][15]. En lugar de seleccionar manualmente el número de estimadores, a menudo es mejor establecer n_estimators alto y confiar en la detención anticipada para evitar el sobreajuste cuando el rendimiento de la validación se estanca. [12][14].

Max_ Depth controla qué tan complejos pueden volverse los árboles y determina el nivel de interacción entre las características principales. Si bien los árboles más profundos pueden adaptarse mejor a los datos de entrenamiento, también corren el riesgo de sobreajustarse. Una profundidad óptima suele estar entre 4 y 10 [12][10]. Parámetros como subsample y colsample_bytree introducen aleatoriedad al utilizar solo un subconjunto de datos o características para cada árbol, lo que ayuda a evitar una dependencia excesiva de muestras específicas. [11][13].

Para conjuntos de datos desequilibrados, scale_pos_weight es particularmente útil. Ajusta el peso de los clientes potenciales positivos, mejorando la capacidad del modelo para detectar clientes potenciales de alto valor en conjuntos de datos sesgados [11][13]. LightGBM, un popular marco de mejora de gradiente, utiliza el crecimiento de árboles en hojas para una convergencia más rápida. Sin embargo, esto requiere ajustar parámetros como num_leaves y min_data_in_leaf para evitar el sobreajuste. Para conjuntos de datos grandes, establecer min_data_in_leaf en valores más altos (cientos o miles) garantiza que el modelo no cree reglas demasiado específicas que no se generalicen bien [14].

| Hiperparámetro | Rol principal | Impacto en la puntuación de clientes potenciales |

|---|---|---|

| tasa_de_aprendizaje | Reducción del tamaño del paso | Los valores más pequeños mejoran la precisión pero requieren más árboles |

| n_estimadores | Número de rondas de impulso | Los valores más altos capturan más patrones, pero corren el riesgo de sobreajustarse |

| max_profundidad | Complejidad del árbol | Controla el nivel de interacción entre las funciones principales |

| submuestra | Aleatorización | Evita la dependencia excesiva de muestras de capacitación específicas |

| scale_pos_weight | Equilibrio de clases | Ajusta ponderaciones para clientes potenciales positivos en conjuntos de datos desequilibrados |

Cada algoritmo tiene su propio conjunto de hiperparámetros que pueden mejorar o deshacer su rendimiento. Ajustar estas configuraciones garantiza que su modelo de puntuación de clientes potenciales sea preciso y confiable, independientemente de los desafíos del conjunto de datos.

Técnicas de ajuste de hiperparámetros

Lead Scoring Models" style="max-width:100%; margin:1em auto; display:block;">

Lead Scoring Models" style="max-width:100%; margin:1em auto; display:block;">

Ajuste de hiperparámetrosComparación de métodos para modelos de puntuación de clientes potenciales

Una vez que haya identificado los hiperparámetros clave para su modelo de puntuación de clientes potenciales, el siguiente paso es seleccionar un método de ajuste que pueda mejorar su rendimiento de manera efectiva. A continuación se presentan algunas técnicas comunes, cada una adecuada para diferentes escenarios.

Búsqueda de cuadrícula

Grid Search es un enfoque metódico que prueba cada combinación posible de valores de hiperparámetros predefinidos [5]. Por ejemplo, si está ajustando un modelo de regresión logística con tres valores posibles para el parámetro de regularización C (0,1, 1,0, 10,0) y dos tipos de penalización (L1, L2), Grid Search evaluará las seis combinaciones. Este enfoque exhaustivo funciona bien para modelos con solo unos pocos hiperparámetros, pero se vuelve computacionalmente costoso a medida que aumenta el número de parámetros [5].

Búsqueda aleatoria

A diferencia de la búsqueda de cuadrícula, la búsqueda aleatoria no evalúa todas las combinaciones. En su lugar, muestra aleatoriamente una cantidad determinada de configuraciones de distribuciones predefinidas [16]. Usted controla el proceso estableciendo un número fijo de iteraciones (n_iter), lo que permite una exploración eficiente del espacio de hiperparámetros [5]. Este método es particularmente útil para modelos con muchos parámetros, como los bosques aleatorios, ya que evita el costo de tiempo exponencial de las búsquedas exhaustivas. Es especialmente eficaz para parámetros continuos, como tasas de aprendizaje, donde distribuciones como loguniformes pueden ayudar a explorar una amplia gama de valores [3].

Métodos avanzados: búsqueda bayesiana y de cuadrícula a la mitad

Para escenarios donde los recursos computacionales son limitados o la capacitación es costosa, los métodos avanzados ofrecen alternativas más eficientes.

- Reducción a la mitad sucesiva: Esta técnica funciona como un torneo. Todas las configuraciones de hiperparámetros se prueban inicialmente con recursos mínimos, como un pequeño subconjunto de datos de entrenamiento. Sólo los que tienen mejor desempeño pasan a la siguiente ronda, donde reciben más recursos. Este enfoque elimina rápidamente las opciones más débiles, lo que lo hace ideal para grandes conjuntos de datos. Por ejemplo, si su modelo de puntuación de clientes potenciales procesa millones de registros, herramientas como HalvingRandomSearchCV pueden identificar de manera eficiente combinaciones de hiperparámetros prometedoras [5].

- Optimización bayesiana: este método trata el ajuste de hiperparámetros como un problema de regresión, utilizando resultados anteriores para predecir las configuraciones más prometedoras [4]. Logra un equilibrio inteligente entre explorar nuevas posibilidades y perfeccionar buenas opciones conocidas. La optimización bayesiana es particularmente efectiva para problemas con menos de 20 dimensiones [17], lo que la convierte en una excelente opción cuando la precisión es crítica y la capacitación requiere muchos recursos. Sin embargo, su naturaleza secuencial puede limitar el procesamiento paralelo [3].

| Tecnologíaúnico | Mejor para | Ventaja clave | Limitación |

|---|---|---|---|

| Búsqueda de cuadrícula | Modelos simples (1–2 parámetros) | La búsqueda exhaustiva garantiza encontrar la mejor configuración | El costo computacional crece exponencialmente |

| Búsqueda aleatoria | Modelos complejos (Random Forest, XGBoost) | Presupuesto fijo; eficiente para espacios de alta dimensión | Es posible que se pierda la mejor configuración absoluta debido al muestreo |

| Reducción a la mitad sucesiva | Grandes conjuntos de datos | Descarta rápidamente configuraciones débiles | El proceso iterativo introduce cierta dependencia |

| Optimización bayesiana | Modelos caros de entrenar | Requiere menos pruebas para identificar los valores óptimos | Escalado paralelo limitado debido al enfoque secuencial |

A continuación, profundizaremos en las mejores prácticas para ajustar los hiperparámetros en los modelos de puntuación de clientes potenciales.

sbb-itb-817c6a5

Prácticas recomendadas para el ajuste de hiperparámetros en la puntuación de clientes potenciales

A partir de las técnicas de ajuste analizadas anteriormente, estas mejores prácticas pueden ayudar a ajustar su modelo para obtener un mejor rendimiento.

Comience con los parámetros más impactantes

Una vez que haya identificado los hiperparámetros clave, concéntrese en aquellos que tienen la mayor influencia en el rendimiento de su modelo. A menudo, solo una pequeña cantidad de parámetros impactan significativamente los resultados, mientras que otros pueden permanecer en su configuración predeterminada [5][3]. Piense en los hiperparámetros como los diales críticos de su modelo: pequeños ajustes pueden generar grandes cambios.

Para Regresión logística, priorice el ajuste C (fuerza de la regularización) y el tipo de penalización (L1 o L2). Estos controlan el sobreajuste y permiten la selección automática de funciones, especialmente cuando se trabaja con datos de clientes de alta dimensión. Para modelos basados en árboles como Random Forest o Gradient Boosting, céntrese en parámetros como n_estimators, max_depth y min_samples_leaf para lograr un equilibrio entre la complejidad y la precisión del modelo. Con Gradient Boosting, el learning_rate es particularmente importante, ya que influye en el comportamiento de otros parámetros. [5][1][[HTML_ 474]][2][18].

El Google Deep Learning Tuning Playbook sugiere clasificar los parámetros en dos grupos: "científicos" (aquellos que miden efectos específicos, como la profundidad del modelo) y "molestos" (aquellos que garantizan comparaciones justas, como la tasa de aprendizaje) [18]. Callearte simple y aumentar gradualmente la complejidad:

"La forma más eficaz de maximizar el rendimiento es comenzar con una configuración simple y agregar funciones de forma incremental y realizar mejoras mientras se obtiene información sobre el problema" [18]

Al explorar rangos para parámetros como tasas de aprendizaje o fortalezas de regularización, use una escala logarítmica en lugar de una escala lineal [3]. Por ejemplo, pruebe las tasas de aprendizaje en 0,001, 0,01, 0,1 y 1,0 en lugar de utilizar pasos lineales como 0,1, 0,2, 0,3 y 0,4. Este enfoque captura diferencias significativas de manera más efectiva.

Utilice las métricas de evaluación adecuadas

La precisión por sí sola puede ser engañosa en la puntuación de clientes potenciales. Por ejemplo, si el 95% de sus clientes potenciales no se convierten, un modelo que predice "no conversión" para cada cliente potencial aún lograría una precisión del 95%, pero no proporcionaría ningún valor a su negocio. [5][21]. Por eso es esencial contar con métricas más matizadas.

ROC AUC (Área bajo la curva característica operativa del receptor) es una opción popular para la puntuación de clientes potenciales. Mide qué tan bien su modelo distingue entre clientes potenciales convertidos y no convertidos en todos los umbrales de probabilidad, lo que lo hace ideal para clasificar los clientes potenciales según su probabilidad de convertir [21].

Otras métricas a considerar:

- Precisión: Esto le indica cuántos de los clientes potenciales que su modelo identifica como de alto valor realmente convierten. Es especialmente importante cuando los recursos de ventas son limitados.

- Recordar: Esto mide el porcentaje de convertidores reales que su modelo identifica correctamente. Es vital cuando perder incluso un solo cliente potencial podría afectar los ingresos.

- F1-Score: esta métrica equilibra la precisión y la recuperación, lo que la hace útil para conjuntos de datos donde las no conversiones superan ampliamente a las conversiones [21].

También puedes crear métricas comerciales personalizadas adaptadas a tus objetivos. Por ejemplo, un estudio de caso optimizó las ganancias al tener en cuenta $120 de ingresos por conversión frente a un costo de $15 de divulgación. Este enfoque condujo a un aumento del 1,2 % en el beneficio total [2]:

"Las métricas de evaluación de aprendizaje automático que elija deben reflejar las métricas comerciales que desea optimizar con la solución de aprendizaje automático" [20]

| Métrica | Alineación empresarial | Cuándo priorizar |

|---|---|---|

| AUC de la República de China | Priorización de clientes potenciales | Clasificación de clientes potenciales según probabilidad de conversión |

| Precisión | Eficiencia en ventas | Cuando los recursos de ventas son limitados |

| Retirar | Maximización de ingresos | Cuando perder clientes potenciales listos para la conversión es costoso |

| Puntuación F1 | Rendimiento equilibrado | Evitar sesgos hacia la precisión o la recuperación |

Las métricas correctas, combinadas con el conocimiento del dominio, pueden hacer que tu proceso de ajuste sea más efectivo.

Aplicar conocimientos de dominio

La experiencia en ventas juega un papel crucial en la definición de rangos de hiperparámetros realistas, lo que puede ahorrar tiempo de cálculo y mejorar la generalización de su modelo [3]. Por ejemplo, comprender el comportamiento del cliente puede ayudarle a sopesar los costos de una clasificación errónea. Si los recursos de ventas son escasos, priorice la precisión. Por otro lado, si perder incluso un cliente potencial calificado podría resultar en una pérdida significativa, concéntrese en recuperar [2][19].

Herramientas como SHAP valores pueden ayudar a garantizar que sus elecciones de hiperparámetros no introduzcan involuntariamente fugas de datos ni enfaticen demasiado patrones irrelevantes [2]. Por ejemplo, si los datos históricos muestran que los clientes potenciales que pasan más de 20 minutos en su sitio web tienen una tasa de conversión del 90%, esta información puede guiar las decisiones sobre la profundidad del árbol o las interacciones entre funciones [2].

En un conjunto de datos con más de 9000 entradas, la aplicación del conocimiento del dominio para eliminar indicadores económicos altamente correlacionados utilizando el factor de inflación de varianza (VIF) mejoró la interpretabilidad del modelo sin sacrificar el rendimiento [21]. Esto destaca cómo la combinación de experiencia en ventas con técnicas estadísticas puede generar modelos que no solo son precisos sino también procesables para su equipo.

Implementación del ajuste de hiperparámetros con scikit-learn

Scikit-learn simplifica el ajuste de hiperparámetros con sus herramientas integradas. Para evitar errores causados por errores tipográficos o nombres de parámetros incorrectos, utilice estimator.get_params() para verificar los parámetros disponibles. Cuando se trabaja en la puntuación de clientes potenciales, es mejor optimizar las probabilidades (por ejemplo, scoring="roc_auc" o scoring="average_precision") en lugar de predicciones binarias, especialmente cuando se trata de conjuntos de datos desequilibrados.

Para un ajuste más rápido, configure n_jobs=-1 para utilizar todos los núcleos de CPU disponibles y use error_score=0 para manejar combinaciones de parámetros problemáticas sin interrumpir el proceso. Divida siempre su conjunto de datos en un conjunto de desarrollo para realizar ajustes y un conjunto de evaluación separado para probar el rendimiento con datos invisibles. De forma predeterminada, scikit-learn vuelve a entrenar el mejor modelo en todo el conjunto de datos cuando refit=True está habilitado.

Ejemplo de búsqueda en cuadrícula para regresión logística

Al ajustar la regresión logística para la puntuación de clientes potenciales, concéntrese en ajustar la intensidad de la regularización (C) y el tipo de penalización (l1 o l2). A continuación se muestra un ejemplo de cómo implementar la búsqueda en cuadrícula para este propósito:

from sklearn.model_selection import GridSearchCV

from sklearn.linear_model import LogisticRegression

from sklearn.model_selection import RepeatedStratifiedKFold

# Define the parameter grid

param_grid = {

'C': [0.001, 0.01, 0.1, 1.0, 10.0, 100.0],

'penalty': ['l1', 'l2'],

'solver': ['liblinear'] # Required for l1 penalty

}

# Set up the model

model = LogisticRegression(max_iter=1000, random_state=42)

# Configure cross-validation

cv = RepeatedStratifiedKFold(n_splits=5, n_repeats=3, random_state=42)

# Create the grid search

grid_search = GridSearchCV(

estimator=model,

param_grid=param_grid,

scoring='roc_auc',

cv=cv,

n_jobs=-1,

error_score=0

)

# Fit on your lead data

grid_search.fit(X_train, y_train)

# Access the best parameters and score

print(f"Best parameters: {grid_search.best_params_}")

print(f"Best ROC AUC: {grid_search.best_score_:.4f}")

El parámetro C es testimado en una escala logarítmica para identificar diferencias significativas en una amplia gama de valores. Para un ajuste más rápido, considere usar LogisticRegressionCV, que está optimizado para calcular la ruta de regularización.

Ejemplo de búsqueda aleatoria para árboles de decisión

Cuando el espacio de parámetros es grande, RandomizedSearchCV es una opción más eficiente en comparación con la búsqueda exhaustiva en cuadrícula. Prueba un número fijo de combinaciones de parámetros, lo que lo hace ideal para modelos como árboles de decisión. Aquí tienes un ejemplo:

from sklearn.model_selection import RandomizedSearchCV

from sklearn.tree import DecisionTreeClassifier

from scipy.stats import randint

# Define parameter distributions

param_distributions = {

'max_depth': randint(3, 20),

'min_samples_split': randint(2, 50),

'min_samples_leaf': randint(1, 30),

'class_weight': ['balanced', None]

}

# Set up the model

model = DecisionTreeClassifier(random_state=42)

# Create the randomized search

random_search = RandomizedSearchCV(

estimator=model,

param_distributions=param_distributions,

n_iter=100, # Number of parameter combinations to try

scoring='roc_auc',

cv=5,

n_jobs=-1,

random_state=42,

error_score=0

)

# Fit on your lead data

random_search.fit(X_train, y_train)

# Get results

print(f"Best parameters: {random_search.best_params_}")

print(f"Best ROC AUC: {random_search.best_score_:.4f}")

El parámetro n_iter controla cuántas combinaciones se prueban, lo que le permite equilibrar la minuciosidad con las limitaciones de tiempo. Para un ajuste aún más rápido en conjuntos de datos grandes, pruebe HalvingRandomSearchCV, que elimina las combinaciones deficientes de parámetros en las primeras etapas del proceso.

En un estudio de scikit-learn, los investigadores utilizaron GridSearchCV con RepeatedStratifiedKFold (10 pliegues, 10 repeticiones) para comparar núcleos SVC. Observaron que el kernel 'rbf' alcanzó un AUC medio de 0,9400, mientras que el kernel 'lineal' obtuvo una puntuación de 0,9300 [22]. Esto destaca cómo el ajuste sistemático puede descubrir diferencias significativas en el rendimiento del modelo.

Una vez que hayas perfeccionado tu modelo con la búsqueda aleatoria, puedes integrarlo en tu flujo de trabajo de puntuación de clientes potenciales para obtener mejores resultados.

Usando SalesMind AI para la puntuación avanzada de clientes potenciales

Después de ajustar su modelo, intégrelo en su proceso de ventas para una mejor priorización de clientes potenciales. SalesMind AI puede incorporar perfectamente su modelo optimizado y aprovecharlo para clasificar a los clientes potenciales según su probabilidad de conversión. Con funciones como una bandeja de entrada unificada impulsada por AI y seguimientos automatizados, SalesMind AI garantiza que los clientes potenciales de alta prioridad reciban atención inmediata, mientras que otros son guiados a través de secuencias de fomento. Esta combinación de ajuste preciso y automatización avanzada puede aumentar significativamente la eficiencia de su divulgación.

Conclusión

Conclusiones clave

El ajuste de hiperparámetros hace que la puntuación de clientes potenciales pase de ser un juego de adivinanzas a un proceso basado en datos. Con las configuraciones adecuadas, su modelo puede identificar con mayor precisión prospectos de alto valor, lo que genera una mejor eficiencia de ventas y mayores ingresos. Comience con configuraciones sencillas y priorice los parámetros que más importan, como la intensidad de la regularización para la regresión logística o la profundidad del árbol para los modelos de conjunto. Las métricas como ROC AUC o la precisión promedio funcionan mejor, especialmente cuando su conjunto de datos está desequilibrado y la mayoría de los clientes potenciales no se convierten.

Para espacios de parámetros pequeños, Grid Search es una opción confiable. La búsqueda aleatoria, por otro lado, ofrece resultados comparables y requiere menos recursos computacionales. Si está preparado para técnicas más avanzadas, la optimización bayesiana ofrece una forma inteligente de explorar parámetros aprendiendo de pruebas anteriores. El uso de políticas conservadoras de parada temprana, como la parada media, puede reducir los costos computacionales entre un 25% y un 35% sin comprometer la calidad del modelo [6]. Es importante destacar que alinear su estrategia de ajuste con los objetivos comerciales, como optimizar para una métrica de ganancias personalizada en lugar del AUC estándar, puede marcar una diferencia tangible. Por ejemplo, un caso study mostró que sus ganancias aumentaron de $88,830 a $89,925 al adoptar este enfoque [2].

Estas estrategias proporcionan un camino claro para poner en práctica el ajuste de hiperparámetros.

Próximos pasos

Con estas conclusiones en mente, es hora de perfeccionar e implementar su modelo de puntuación de clientes potenciales. Comience auditando su configuración actual para identificar qué hiperparámetros tienen la mayor influencia en su conjunto de datos. A partir de ahí, establezca un proceso de ajuste sistemático utilizando herramientas como scikit-learn. Esté atento a las curvas de entrenamiento y validación para detectar el sobreajuste temprano y siempre valide su modelo final en un conjunto de evaluación separado para garantizar que funcione bien con nuevos clientes potenciales.

Para aprovechar al máximo su modelo optimizado, SalesMind AI ofrece herramientas para agilizar el proceso. Prioriza automáticamente los clientes potenciales en función de su probabilidad de realizar una conversión, inicia secuencias de divulgación personalizadas y envía instantáneamente los clientes potenciales con puntuaciones altas a su equipo de ventas. Esta combinación de modelado afinado y automatización inteligente garantiza que sus principales clientes potenciales reciban atención inmediata, mientras que su equipo puede concentrarse en cerrar acuerdos en lugar de clasificar prospectos no calificados.

Preguntas frecuentes

¿Cómo mejora el ajuste de hiperparámetros la precisión de los modelos de puntuación de clientes potenciales?

El ajuste de hiperparámetros es un paso clave para mejorar la precisión de los modelos de puntuación de clientes potenciales. Ajustar parámetros como la tasa de aprendizaje, la intensidad de la regularización o la profundidad del árbol ayuda al modelo a identificar patrones en los datos de manera más efectiva, lo que genera predicciones mucho más confiables.

Cuando un modelo de puntuación de clientes potenciales se ajusta correctamente, asigna puntuaciones que se alinean estrechamente con las verdaderas posibilidades de conversión de un cliente potencial. Esto permite a las empresas centrarse en clientes potenciales de alto potencial, lo que en última instancia agiliza los esfuerzos de ventas y mejora los resultados.

¿Cuál es la diferencia entre la búsqueda de cuadrícula y la optimización bayesiana para el ajuste de hiperparámetros?

Grid Search funciona probando sistemáticamente cada combinación posible de hiperparámetros especificados dentro de un rango determinado. Este método garantiza que se encontrará la mejor configuración dentro de la red. Sin embargo, puede consumir muchos recursos, especialmente cuando se trabaja con una gran cantidad de parámetros o conjuntos de datos extensos.

Por el contrario, la optimización bayesiana adopta un enfoque más inteligente. Utiliza un modelo probabilístico para predecir cómo funcionarán las diferentes combinaciones de hiperparámetros. Al centrarse en las áreas más prometedoras, puede identificar configuraciones óptimas de manera más eficiente. Esto lo convierte en una excelente opción para escenarios que involucran datos de alta dimensión o recursos computacionales limitados. Dicho esto, viene con una sobrecarga computacional adicional para mantener el modelo y puede ser sensible a la estrategia de optimización elegida.

En pocas palabras, la Grid Search es una opción sencilla para problemas más pequeños, mientras que la Optimización bayesiana brilla al abordar desafíos de ajuste más complejos o de gran escala donde la eficiencia importa.

¿Por qué ROC AUC es una métrica mejor que la precisión para evaluar modelos de puntuación de clientes potenciales?

Cuando se trata de evaluar modelos de puntuación de clientes potenciales, ROC AUC a menudo eclipsa la precisión, especialmente porque los conjuntos de datos de puntuación de clientes potenciales tienden a estar desequilibrados. En estos escenarios, la precisión puede parecer impresionante en la superficie, pero puede ser engañosa, ya que no refleja la capacidad del modelo para identificar clientes potenciales valiosos.

Lo que distingue a ROC AUC es su capacidad para evaluar qué tan bien el modelo diferencia entre clientes potenciales positivos y negativos en todos los umbrales de decisión posibles. Esto lo convierte en una métrica mucho más confiable para comprender la eficacia con la que el modelo clasifica y prioriza los clientes potenciales de alta calidad.